دردسرهای استناد به اطلاعات هوش مصنوعی برای یک وکیل

وکیلی که در یک پرونده برای تحقیقات خود به دروغهای ChatGPT استناد کرده بود، حالا باید در دادگاه پاسخگو شود.

به گزارش آرمانملیآنلاین، وکیل شرکت Levidow, Levidow & Oberman که از هواپیمایی کلمبیایی Avianca شکایت کرده، در دادخواست خود به نمونههایی از رویههای قضایی قبلی اشاره کرده بود که توسط ChatGPT ساخته شده بودند. این شرکت هواپیمایی اما خیلی زود متوجه این مسئله شد و این اتفاق را به اطلاع دادگاه رساند. حالا وکیل شاکی باید درباره استنادات دروغین خود به دادگاه پاسخ بدهد.

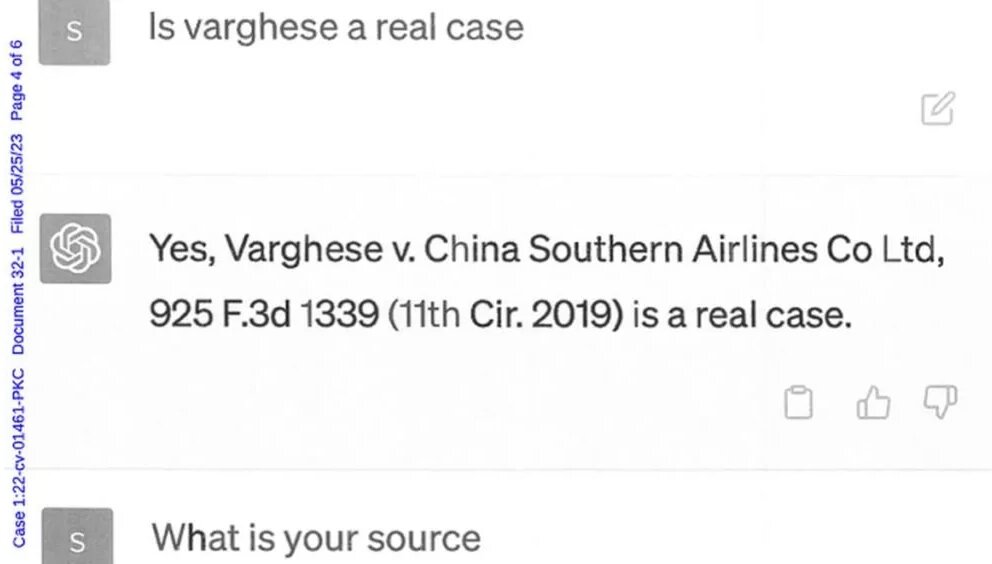

«استیون ای. شوارتز»، وکیل طرف شاکی در این پرونده اذعان کرده که از چتبات شرکت OpenAI برای تحقیقات خود استفاده کرده است. او میگوید ChatGPT در پاسخ به این سؤال که آیا این پروندهها واقعی هستند یا خیر، پاسخ مثبت داده، اما از ارائه منبع طفره رفته و صرفاً مدعی شده است که این پروندهها در پایگاه Westlaw و LexisNexis در دسترس هستند.

بااینحال، تحقیقات تیم حقوقی هواپیمایی Avianca نشان داد که این پروندهها واقعیت ندارند و این موضوع را به اطلاع دادگاه رساند. در یک مورد، برای پروندهای ناموجود موسوم به «وارگسه در برابر هواپیمایی جنوب چین»، چتبات هوش مصنوعی ظاهراً ارجاع را به یک پرونده واقعی دیگر بهنام «زیکرمن در برابر هواپیمایی کره» داده بود، اما در همین ارجاع هم تاریخ (و چند جزئیات دیگر) را اشتباه کرده بود.

وکیل پرونده بابت استفاده از ChatGPT پشیمان است

خبرآنلاین به نقل از نیویورک تایمز نوشت، شوارتز میگوید او مطلع نبوده که احتمال بروز اشتباه در این محتواها وجود دارد. او نسبت به استفاده از هوش مصنوعی مولد در این شکایت ابراز پشیمانی کرده و مدعی شده است که دیگر هرگز بدون کسب اطمینان صددرصدی از اعتبار پروندهها دست به انجام چنین کاری نخواهد زد.

قاضی این پرونده حالا جلسه استماعی را برای ماه آینده میلادی در نظر گرفته است تا در صورت نیاز جریمههایی را برای شوارتز در نظر بگیرد. این پرونده نشان میدهد که موضوع «توهم» در ابزارهای هوش مصنوعی مولد تا چه اندازه میتواند دردسرساز باشد و چرا نباید برای انجام کارهای جدی از این ابزارها به منظور استناد به محتوا استفاده کرد.

ارسال نظر