یک قاضی فدرال در تگزاس خطاب به وکلا

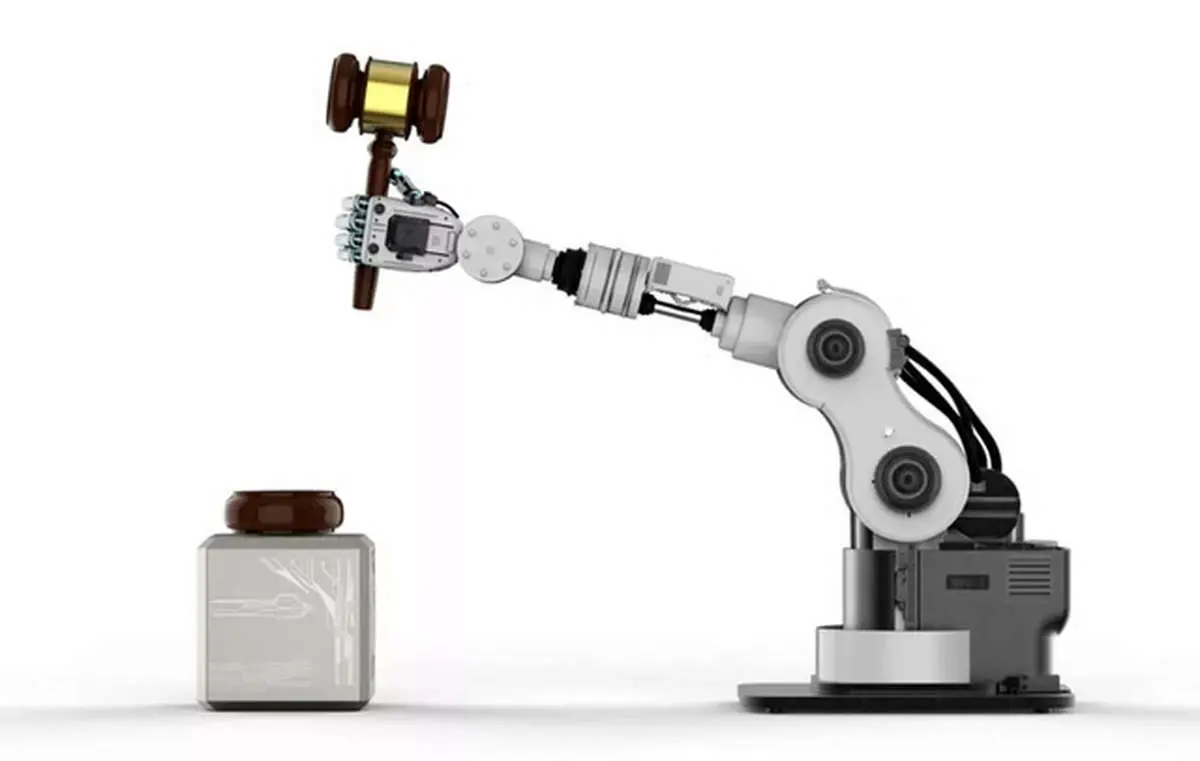

استفاده از هوش مصنوهی ممنوع!/ شرط قاضی آمریکایی برای وکلا

یک قاضی فدرال تگزاس میگوید از این به بعد وکلا باید شهادت بدهند که برای تنظیم لوایح از هوش مصنوعی استفاده نکردهاند یا محتواهای تولیدیشان را یک انسان بررسی کرده است.

آرمان ملی آنلاین: یک قاضی در آمریکا برای مقابله با هوش مصنوعی پیشنیاز جدیدی را جهت حضور در دادگاه معرفی کرد.

یک قاضی فدرال تگزاس میگوید از این به بعد وکلا باید شهادت بدهند که برای تنظیم لوایح از هوش مصنوعی استفاده نکردهاند یا محتواهای تولیدیشان را یک انسان بررسی کرده است.

تعداد وکلایی که برای تنظیم لوایح خود حاضر به استفاده از هوش مصنوعی باشند، کم است. بااینحال، هفته گذشته در گزارشی اعلام شد که یک وکیل دست به چنین کاری زده و این اقدام برای او دردسرساز شده است. حالا قاضی فدرال تگزاس اولین گام مهم را برداشته است تا مطمئن شود که استفاده از هوش مصنوعی در صحن دادگاه او مشکلساز نمیشود.

بهگزارش تککرانچ، قاضی «برنتلی استار» پیشنیازی را به ملزومات حضور در دادگاه خود اضافه کرده است که طی آن وکلا باید شهادت بدهند که در دادخواستهای خود از محتواهای تولیدشده توسط هوش مصنوعی استفاده نکردهاند، یا چنانچه دست به چنین کاری زده باشند، آن محتوا حتماً باید توسط یک انسان بررسی شده باشد.

پیشنیاز جدید حضور در دادگاه که توسط قاضی فدرال تگزاس معرفی شده، «تصدیق اجباری درباره هوش مصنوعی مولد» نام دارد و میگوید: «تمام وکلایی که در پیشگاه دادگاه حاضر میشوند، باید سند تصدیقی را ارائه کنند که نشان بدهد هیچ بخشی از دادخواست آنها توسط هوش مصنوعی مولد (ازجمله ChatGPT ،Harvey.AI یا بارد گوگل) تنظیم نشده یا اگر از هوش مصنوعی مولد استفاده شده، دقت این محتواها از طریق گزارشهای مکتوب یا پایگاههای داده حقوقی توسط یک انسان بررسی شده است.»

توضیح قاضی تگزاس درباره مقابله با هوش مصنوعی چیست؟

نکته جالب اینجاست که دفتر قاضی استار توضیحات بسیار مناسبی را برای افزودن این پیشنیاز ارائه کرده است. این دفتر میگوید ابزارهای هوش مصنوعی مولد مستعد توهم و سوگیری هستند. به دفعات دیده شده است که این ابزارها مطالب غیرواقعی را بیان میکنند. از طرف دیگر، وکلا سوگند خوردهاند که جانبداریهای شخصی خود را کنار بگذارند، اما هوش مصنوعی میتواند سوگیریهای خطرناکی داشته باشد و این اصل را زیر پا بگذارد.

هفته گذشته وکیلی بهنام «استیون شوارتز» از ChatGPT برای یافتن نمونههای قبلی رأی دادگاهها درباره یک موضوع حقوقی استفاده کرد و به اشتباه به وقایعی استناد کرد که وجود خارجی نداشتند. حالا اگرچه تصمیم برنتلی استار فقط محدود به دادگاه خود او خواهد بود، اما باید دید که آیا بقیه قضات هم تصمیمات مشابهی را اتخاذ خواهند کرد یا خیر.

ارسال نظر